З появою штучного інтелекту (ШІ) соціальні мережі стали ще більш потужним інструментом для зв’язку та обміну інформацією. Однак ця ж технологія використовується шахраями для створення більш складних та переконливих схем обману. У цій статті ми дослідимо, як ШІ використовується для шахрайства в соцмережах, та розглянемо, як захистити себе від цих загроз.

- Реклама, що просуває шкідливе програмне забезпечення

- Шахрайство зі згенерованим штучним інтелектом соціальним профілем

- Шахрайство з видаванням себе за іншу особу

- Шахрайство з продажем продуктів, пов’язаних зі штучним інтелектом

- Як від цього вберегтися

- Залишайтеся в безпеці в соціальних мережах в епоху штучного інтелекту

Реклама, що просуває шкідливе програмне забезпечення

Прокручуючи сторінки Facebook та інших соціальних мереж, ви, швидше за все, помітите рекламу про інструменти штучного інтелекту. Хоча деякі з цих оголошень є достовірними і розповідають про реальні інструменти, багато з них є шахрайськими, які намагаються просувати трояни та віруси для зараження вашого пристрою. Деякі з цих шахрайських оголошень безпосередньо націлені на відомі інструменти ШІ, такі як ChatGPT, Gemini і Microsoft Copilot, щоб виглядати більш правдоподібно.

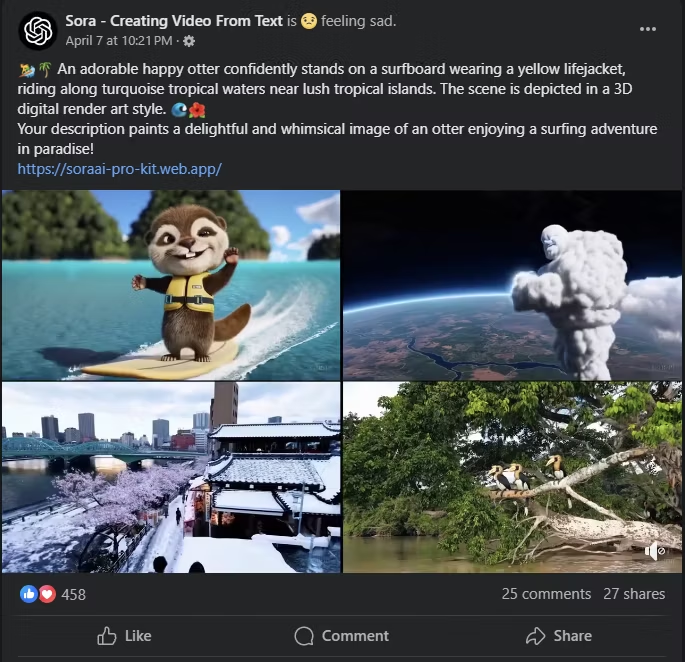

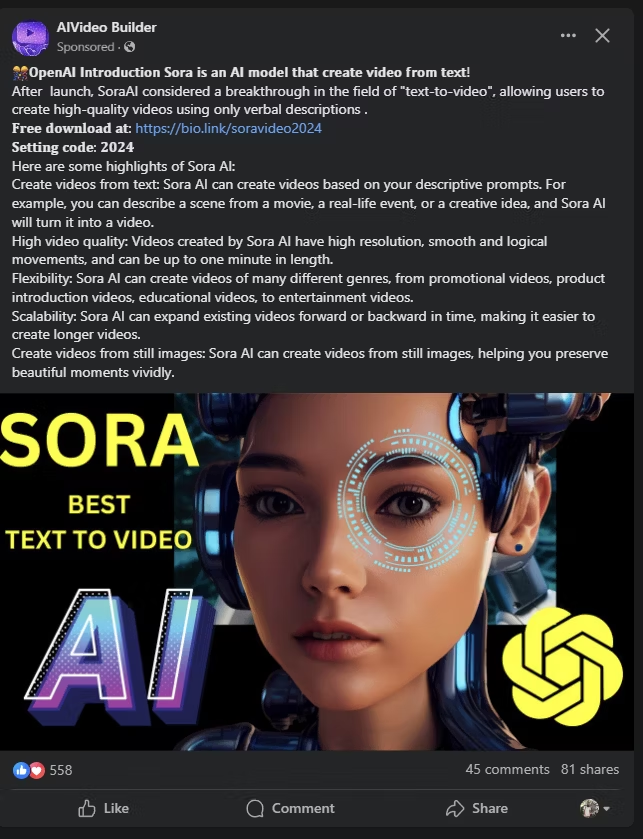

Візьмемо, наприклад, наведену нижче рекламу про модель штучного інтелекту Sora від OpenAI.

На момент написання цієї статті Sora ще не була випущена для широкого загалу. Однак, як і в цьому випадку, щоразу, коли компанія анонсує новий інструмент ШІ, і він отримує певну популярність, деякі соціальні сторінки поводяться так, ніби вони просувають ці інструменти, хоча насправді вони намагаються вас обдурити. Іноді ви знайдете сторінки, які видають себе не за саму компанію, а за третіх осіб, які просувають інструменти штучного інтелекту. Техніка дуже схожа. Ось одна з них для прикладу.

Інший поширений випадок – це коли будь-який з цих інструментів АІ отримує велике оновлення. Тоді ці фейкові сторінки створюють рекламу, пов’язану з оновленням, і просять вас завантажити останню версію інструменту. Ось приклад саме такого випадку.

Ще більше занепокоєння викликає те, що деякі люди дійсно потрапляють на ці шахрайські схеми. Про це свідчить активність у таких оголошеннях. Завантаживши запропоноване “програмне забезпечення”, розпакувавши його та встановивши, ви встановлюєте шкідливе програмне забезпечення на свій пристрій. Швидше за все, шахрай може отримати доступ до всієї вашої системи, включно з обліковими даними соціальних мереж та іншою конфіденційною інформацією.

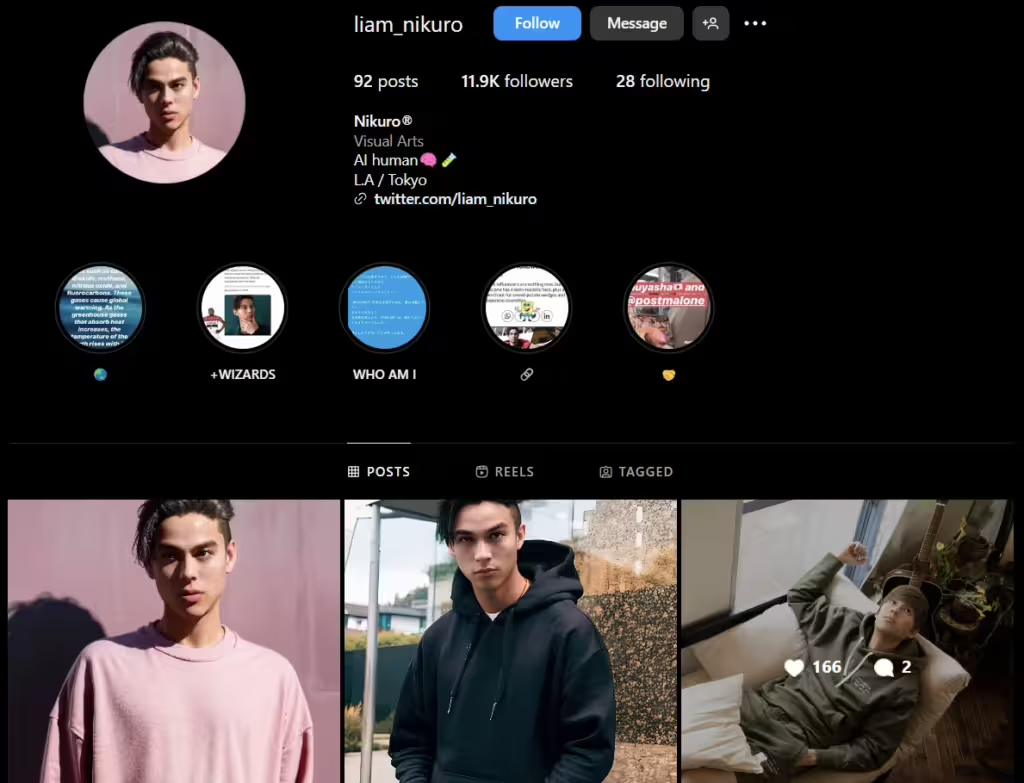

Шахрайство зі згенерованим штучним інтелектом соціальним профілем

У той час як шахраї намагаються використовувати ваші дані в рекламі, пов’язаній зі штучним інтелектом, інша нова загроза полягає у створенні повністю фальшивих профілів у соціальних мережах. Був час, коли люди створювали ботів для фоловінгу та залучення користувачів. Але їх можна було легко ідентифікувати. Завдяки можливостям штучного інтелекту генерувати зображення, будь-хто може створювати реалістичні зображення людей в будь-якій кількості.

Тепер у нас є ШІ-інфлюенсери, віртуальні люди, яких не існує, з тисячами підписників. Хоча на перший погляд це виглядає не так вже й погано, зловмисники можуть використати цю ідею, щоб ошукати інших. Уявіть, що компанія, яка виробляє харчові добавки, використовує цих ШІ-інфлюенсерів для просування своїх небезпечних продуктів. Люди потраплятимуть у цю пастку і купуватимуть їх. Деякі компанії можуть піти далі і створювати зображення “до і після”, щоб показати, як працює їхній продукт. Масове виробництво фальшивих відгуків – ще одне ймовірне використання соціальних профілів зі штучним інтелектом.

Ці профілі, створені штучним інтелектом, також можуть бути спроектовані таким чином, щоб брати участь у начебто справжніх розмовах, будуючи взаєморозуміння з наївними людьми. Це особливо небезпечно в контексті любовних афер, коли шахраї використовують емоційну вразливість людей, щоб виманити гроші або особисту інформацію.

Шахрайство з видаванням себе за іншу особу

Цей тип шахрайства виводить соціальні профілі, створені штучним інтелектом, на новий рівень. Шахраї не обмежуються створенням випадкових профілів, а націлюються на реальних людей і створюють профілі, які відповідають їхній зовнішності та характеру. Вони роблять це, завантажуючи реальні дані цієї людини в моделі штучного інтелекту. Найбільше страждають від цього знаменитості та інтернет-персони.

Шахраї використовують ШІ для створення напрочуд переконливих імітацій реальних людей. Вони можуть використовувати діпфейки та згенеровані ШІ фотографії популярних особистостей, впливових людей або навіть ваших друзів і сім’ї. Потім ці імітації використовуються, щоб завоювати вашу довіру та експлуатувати вас фінансово й емоційно. Деякі технології ШІ можуть клонувати людські голоси, що робить їх ще більш згубними.

Шахрайство з продажем продуктів, пов’язаних зі штучним інтелектом

Це не обов’язково шахрайство, пов’язане з інструментами штучного інтелекту. Однак, оскільки АІ є модною темою, шахраї можуть ще більше використовувати інтерес людей до нього. Одним із видів шахрайства є реклама якогось передового програмного забезпечення для ШІ. Лише коли ви купуєте і використовуєте його, ви розумієте, що це підроблена бутлег-версія існуючих інструментів, яка пропонує мінімальні функціональні можливості порівняно з тим, що було розрекламовано.

Деякі інші шахраї пропонують вам підписку на інструменти штучного інтелекту за нижчою ціною. Насправді вони купують підписку і надають доступ до облікового запису кільком людям. Якщо хтось інший або сам продавець змінить облікові дані акаунта, ви більше не зможете ним користуватися. Навіть гірше, іноді, отримавши гроші, вас одразу ж заблокують. Якщо щось у соціальних мережах виглядає занадто добре, щоб бути правдою, це, ймовірно, так і є. Подивіться на це оголошення нижче, яке рекламує підписку на ChatGPT Plus всього за $8 на рік.

І, звичайно, є так звані гуру ШІ, які продають вам не інструменти, а супутні продукти. Деякі з поширених продуктів, які вони пропонують, включають “перевірені” підказки ШІ, посібники з використання інструментів, курси та все, що стосується заробітку за допомогою ШІ. Насправді ці продукти містять лише поверхневу інформацію і нічого особливого, за що варто платити. Як не дивно, вони заробляють гроші за допомогою ШІ, навчаючи людей, як заробляти гроші за допомогою ШІ.

Це не означає, що немає нічого поганого в продажі продуктів, пов’язаних зі штучним інтелектом, або що немає справжніх експертів у цій галузі. Але дуже багато людей позиціонують себе як експертів у галузі АІ з переробленою інформацією, щоб заробити статки за рахунок інших.

Як від цього вберегтися

Оскільки в соціальних мережах з’являється все більше шахрайств, вам потрібно бути більш пильними у всіх ваших онлайн-взаємодіях. Це стосується і того, з ким ви спілкуєтеся, і того, у кого ви купуєте, і того, яку інформацію ви споживаєте. Інструменти штучного інтелекту швидко вдосконалюються, але, на щастя, можна виявити згенеровані штучним інтелектом новини, фотографії та навіть відео. Ви можете скористатися допомогою інструментів, але навчитися розпізнавати, що є реальним, а що ні, може бути корисним у найближчі дні.

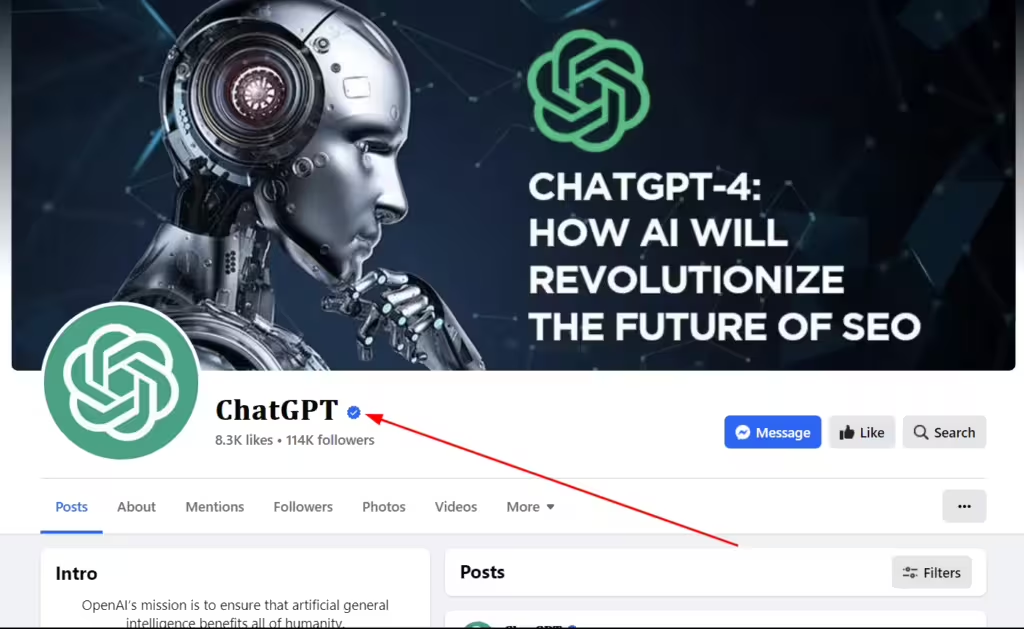

Остерігайтеся оголошень, що надходять з неофіційних джерел. Їх можна розпізнати за поганою граматикою, підозрілими посиланнями та нереалістичними обіцянками. Зазвичай, офіційні сторінки компаній перевірені (перевірте наявність синьої галочки на Facebook) і мають хорошу історію взаємодії.

Будьте особливо обережні, купуючи онлайн. Купуйте тільки у перевірених продавців з хорошою репутацією. Якщо ви знаходите щось дешевше за офіційну ціну, це може бути щось нечесне. Спробуйте провести власне дослідження. Це включає в себе пошук відгуків, перевірку веб-сайту компанії та використання служб перевірки фактів.

Не сприймайте все, що ви бачите в соціальних мережах, за чисту монету. Якщо ви знайшли підозрілі соціальні профілі, рекламу, повідомлення або інші дії, повідомте про них соціальну платформу. Це допоможе компаніям, що займаються соціальними мережами, швидше виявляти та видаляти шахрайство.

Залишайтеся в безпеці в соціальних мережах в епоху штучного інтелекту

Оскільки інструменти штучного інтелекту продовжують вдосконалюватися, ми повинні бути більш обережними в онлайн-світі. З’являться двері нових можливостей, а також нові виклики, які потрібно буде подолати. Дотримуючись наведених вище порад, ви можете зменшити ризик стати жертвою і забезпечити собі позитивний досвід роботи в соціальних мережах.