Останнє покоління сфабрикованих в цифровому вигляді облич вийшло з “дивовижної долини” і потроху доросло аж до фотореалізму. Хоча можливості для розваг із використанням цієї технології безмежні, відео з діпфейками можуть сильно порушити навіть здатність вірити власним очам. Facebook та Університет штату Мічиган презентували новий метод не просто виявлення діпфейку, але і виявлення, яка генеративна модель створила його шляхом зворотного проектування самого зображення.

Окрім того, щоб сказати чи є якесь зображення діпфейком, чимало сучасних систем виявлення можуть визначити, чи було зображення створено в моделі, яку система бачила під час свого навчання – відома як класифікація “наближеної моделі”. Проблема полягає в тому, що якщо зображення було створено за допомогою генеративної моделі, на якій не була навчена система детекторів, система не матиме попереднього досвіду, щоб виявити фальшивку.

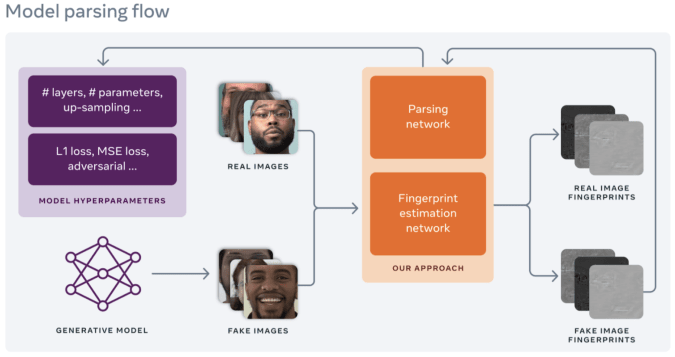

Техніка зворотного інжинірингу спільної команди FB-MSU, хоча і не є абсолютно передовою методологією,” спирається на розкриття унікальних закономірностей моделі ШІ, яка використовується для створення єдиного глибокого фальшивого зображення”, – пояснила команда у своєму записі в блозі в середу.

“Ми починаємо з атрибуції зображення, а потім працюємо над виявленням властивостей моделі, яка була використана для створення зображення”, – продовжила команда. “Узагальнюючи атрибуцію зображень для розпізнавання з відкритим набором, ми можемо зробити більше інформації про генеративну модель, яка використовується для створення діпфейку, яка виходить за рамки визнання того, що цього раніше не бачили”.

Більше того, ця система може порівнювати та відстежувати подібність у серії діпфейків, дозволяючи дослідникам відстежувати групи сфальсифікованих зображень, знаходячи єдине для них генеративне джерело, що має допомогти модераторам соціальних мереж краще відстежувати скоординовані кампанії дезінформації.

Щоб перевірити цю техніку виявлення, дослідники з команди FB-MSU спочатку пропустили набір діпфейків через мережу оцінки відбитків пальців. Алгоритми FEN здатні розпізнавати тонкі візерунки, відбиті на зображеннях конкретним пристроєм, який його створив. Для цифрових фотографій кожен із цих шаблонів унікальний через різницю у виробництві камери, на яку знімалася фотограф. Те саме стосується діпфейків – кожна генеративна модель має свої особливості, що відбиваються на результатах генерації, які можна використовувати для розкриття ідентичності моделі на основі самого зображення.

Оскільки в Інтернеті існує безмежна кількість генеративних моделей, дослідникам довелося узагальнити пошук цих відбитків пальців.

“Ми розрахували відбитки пальців, використовуючи різні обмеження, засновані на властивостях відбитків пальців загалом, включаючи величину відбитків пальців, характер повторюваності, діапазон частот і симетричну частотну характеристику”, – пояснила команда. Потім ці обмеження були введені назад у мережу FEN, “для забезпечення згенерованих відбитків пальців, щоб мати ці бажані властивості”.

Як тільки система могла послідовно відокремлювати справжні відбитки пальців від діпфейків, вона брала всі ці помилкові відбитки пальців і скидала їх в модель синтаксичного аналізу, щоб виділити їх різні гіперпараметри. Гіперпараметри генеративної моделі – це змінні, які вона використовує для керівництва процесом самонавчання. Отже, якщо Ви можете зрозуміти, що це за різні гіперпараметри, Ви можете зрозуміти, яка модель використовувала їх для створення цього зображення. Команда Facebook порівнює це з можливістю ідентифікувати різні компоненти двигуна автомобіля, просто слухаючи його в режимі холостого ходу.

Оскільки команда FB-MSU першою вступила в дослідження цієї області за допомогою цього проекта, немає жодної конкретної базової лінії для порівняння результатів цих випробувань. Тож натомість команда створила свою власну методику і виявила „набагато сильнішу та узагальнену кореляцію між згенерованими зображеннями та простором вбудови значущих архіпараметрів архітектури та типами функцій втрат, порівняно із випадковим вектором тієї ж довжини та розподілу”. Отже, в основному, вони не можуть об’єктивно сказати, наскільки хороша їхня система, оскільки буквально немає інших досліджень, щоб порівняти їх з чимось, але вони знають, що це ефективніше, ніж сподіватися просто на вдачу.

Радимо звернути увагу на поради, про які писав Cybercalm, а саме:

Як виявити та чому краще не сперечатися з “тролями”? ПОРАДИ

Правила безпеки дітей в Інтернеті

Як захистити підлітків від інтернет-шахраїв? ПОРАДИ

До речі, Google планує ускладнити Android-додаткам відстеження користувачів. Компанія анонсувала зміни в те, як обробляються унікальні ідентифікатори пристроїв, що дозволяють відстежувати їх між додатками.

Також Apple має намір випустити оновлення для своїх пристроїв, після якого вони дозволять користувачам дізнаватися, яку саме інформацію про них збирають додатки.

Microsoft детально розповість про “наступне покоління Windows” на спеціальному заході, який відбудеться в кінці цього місяця. Компанія почала розсилку запрошень на захід, який буде повністю присвячено програмній платформі Windows і почнеться о 18:00 (за київським часом) 24 червня.

Окрім цього, зловмисники поширюють шкідливе ПЗ під виглядом популярних Android-додатків від відомих компаній. Підроблений плеєр VLC, антивірус Касперського, а також підроблені додатки FedEx і DHL встановлюють на пристроях жертв банківські трояни Teabot або Flubot, вперше виявлені раніше в цьому році.