Facebook як один зі світових лідерів в розробці технологій штучного інтелекту знайшов прикладне застосування для цих програм: фільтрація спілкування людей. Передові інновації впроваджують в соціальній мережі Instagram (див. Прес-реліз Instagram, а також репортаж в Time з коментарем Йоава Шапіри, провідного розробника нейромережевих класифікаторів буллінгу). Так пишуть в одному з професійних блогів на Habr.com

Нововведення в Instagram

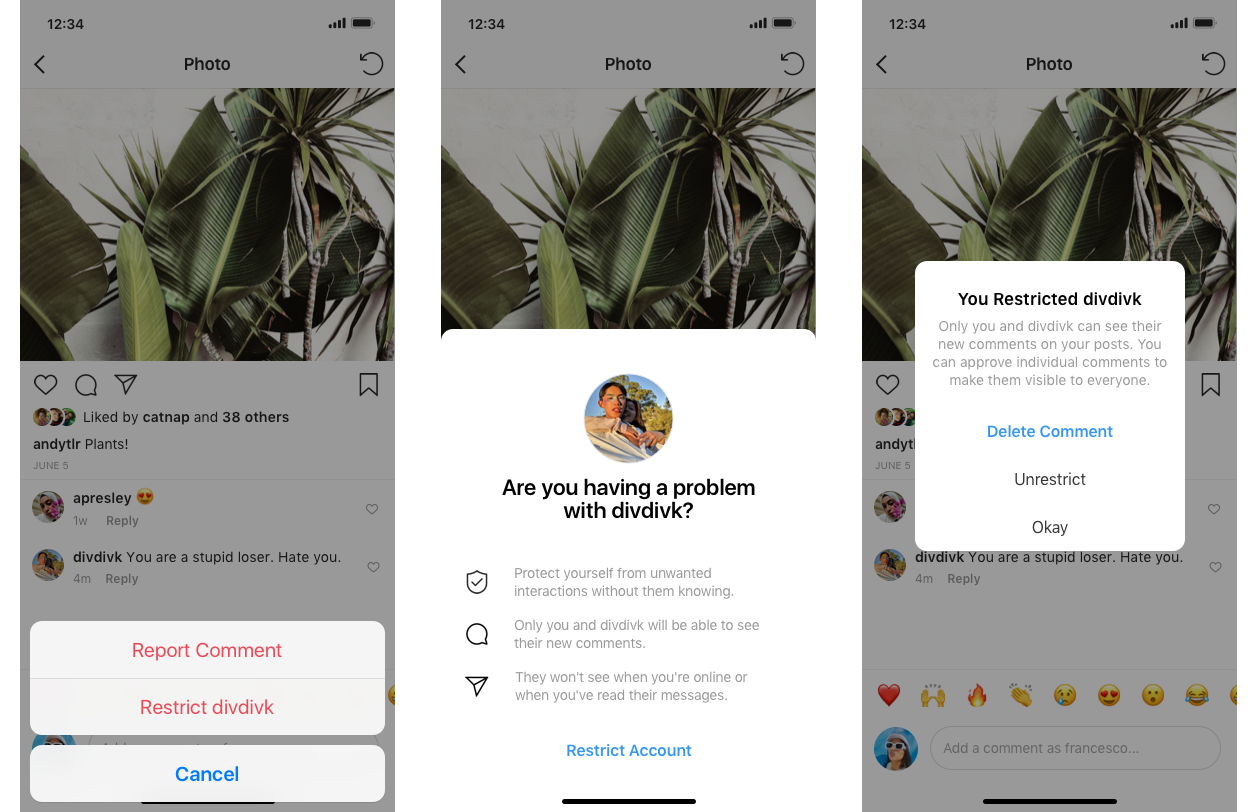

Найцікавіша з нових функцій – що будь-кого можна заблокувати так, що він навіть цього не помітить. Користувач продовжить грубіянити, але його опубліковані повідомлення будуть видимі тільки йому. Це ідеальний варіант, щоб не блокувати грубіяна і не загострювати ситуацію. Втім, саме ця функція не пов’язана з системою ШІ.

Як сказано в прес-релізі, найближчим часом Instagram представить нові функції, які «спрямовані на стримування онлайн-буллінгу». Це відбувається в той час, коли гіганти соціальних мереж стикаються з підвищеною увагою до грубості, з якими стикаються багато користувачів. У всьому світі зростають заклики посилити контроль за такими платформами, як Facebook і Twitter, на тлі широко поширеною критики буллінгу, а також поширення ненависті і фейкових новин.

Instagram з аудиторією в 500 мільйонів чоловік є платформою, орієнтованою на зображення. Тут користувачі розміщують фотографії і відео, які потім прокоментують інші користувачі.

Зараз компанія заявила, що протягом багатьох років використовує ШІ для моніторингу буллінгу і шкідливого контенту, а тепер представляє інтерфейс безпосередньої взаємодії цього ШІ з користувачами.

Дві нові функції

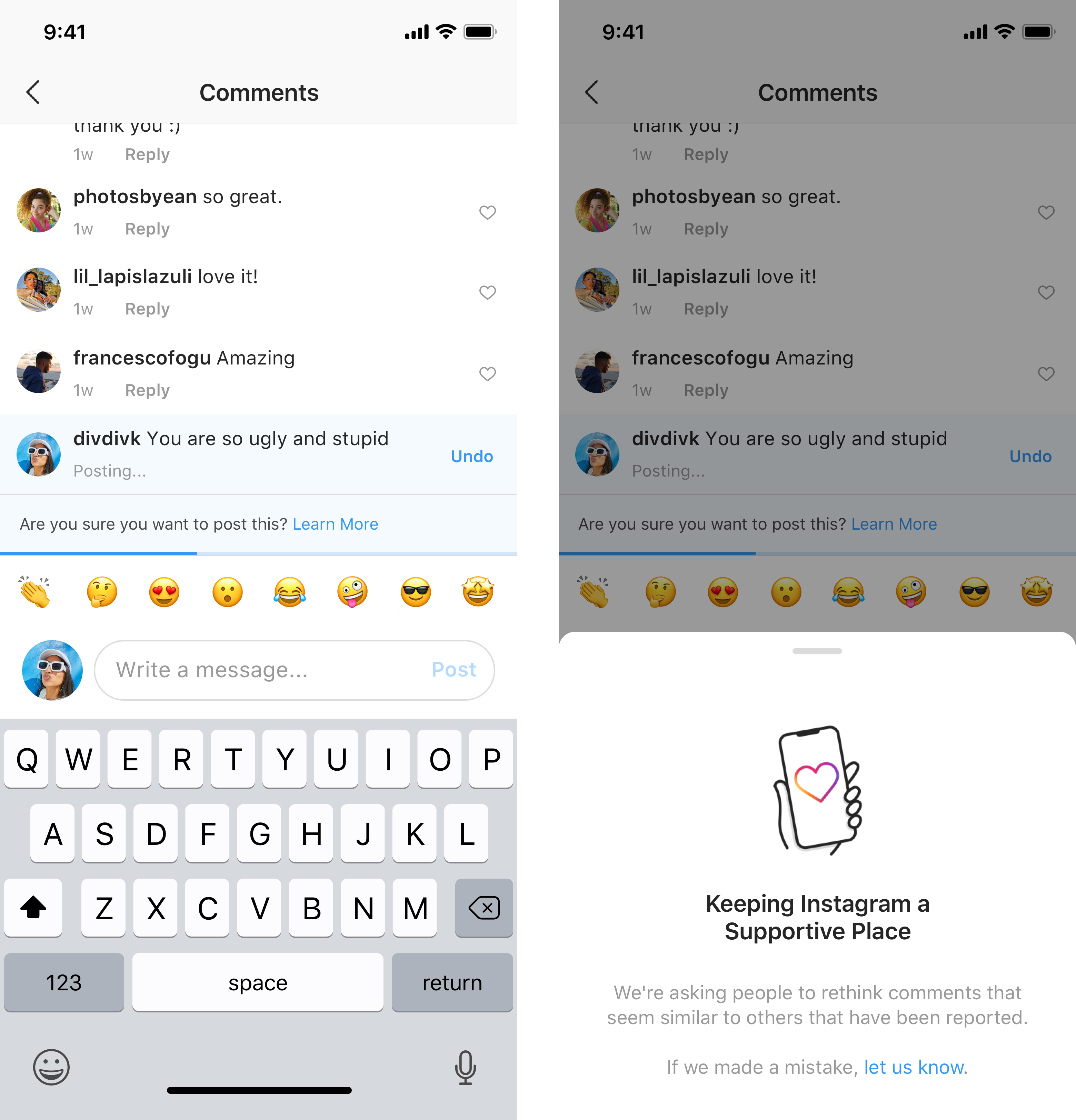

По-перше, це технологія миттєвого виявлення, коли користувач намагається опублікувати щось образливе. Система будемо видавати попередження перед публікацією.

«Це втручання дає людям можливість задуматися і скасувати свій коментар, – йдеться в заяві керівника Instagram Адама Моссера. – З ранніх тестів цієї функції ми виявили, що вона спонукає деяких людей скасувати свій коментар і поділитися чимось менш шкідливим, як тільки у нього з’являється можливість подумати».

Інша нова функція – «Обмеження» (Restrict) – спрямована на обмеження образливих коментарів у стрічці користувача. «

Ми чули від молодих людей в нашому суспільстві, що вони не хочуть ні блокувати, ні видаляти з фоловерів, ні повідомляти про хулігана, тому що це може загострити ситуацію, особливо якщо вони взаємодіють з ним в реальному житті», – сказав Моссера.

Тепер з’явився новий варіант: зробити так, що пости кривдника будуть видимі тільки йому. Грубіяна переводять в «обмежений» (restricted) режим, тобто він буквально стає «обмеженим користувачем».

Крок 1. Ви бачите коментар грубіяна

Крок 2. Ви видаляєте коментар і переводите грубіяна в режим Restricted

«Обмежені люди не зможуть бачити, коли ви активні на Instagram або коли ви прочитали їх прямі повідомлення», – додав Моссера.

Крок Instagram повинен допомогти захистити особливо підлітків. Згідно з опитуванням, опублікованим дослідним центром Pew Research Center в минулому році, 72% підлітків США заявили, що вони використовували Instagram.

Залякування і буллінг є лише одним з багатьох фронтів, на яких від соціальних мереж вимагають дій в останні роки. Ростуть заклики до регулювання таких платформ в зв’язку з поширенням повідомлень, що розпалюють ненависть, і фейкових новин.

Такі компанії, як Facebook, у відповідь на це почали змінювати політику і впроваджувати функції, спрямовані на підвищення прозорості та безпеки. Поки виходить зі змінним успіхом, але без тиску суспільства не було б і цього.

Штучний інтелект

В інтерв’ю Time представники Instagram сказали, що для фільтрації брутального поводження та знущань в майбутньому вони покладаються на технології штучного інтелекту, щоб повністю викорінити буллінг, знущання і неповагу. Молоді люди зараз часто залякані і соромляться, бояться повідомити про неналежну поведінку, дати відсіч групі хуліганів або заблокувати їх. В майбутньому їм не доведеться цього робити: система ШІ сама подбає про слабких.

Створення штучного інтелекту для боротьби з грубістю – це своєрідний технічне Еверест, пише Time. Це означає навчання машин розуміння проблеми зі складними нюансами. Instagram також повинен побоюватися проблем зі свободою слова, оскільки інженери створюють інструменти, які оптимізовані для пошуку того, що треба, не фільтруючи зайвого: «Я турбуюся, що якщо ми не будемо обережні, то можемо переступити межу», – говорить Адам Моссера, глава Instagram. Однак він готовий приймати рішення, які означають зниження активності користувачів в Instagram, якщо це підвищує безпеку.

Сайт для обміну фотографіями практично з самого початку почали використовувати збоченці. 20-річні засновники компанії Кевін Сістром і Майк Крігер цілими днями особисто видаляли неприємні коментарі і блокували тролів. Потім вони застосували інструмент штучного інтелекту , відомий як DeepText, розроблений для розуміння та інтерпретації мови.

Інженери Instagram вперше використовували DeepText в 2016 році для пошуку спаму. У 2017 році його навчили знаходити і блокувати образливі коментарі, включаючи расові образи. До середини 2018 року програму – по суті, набір нейромереж, – навчили знаходити в коментарях також і буллінг, тобто умисну грубість. У жовтні 2018 року компанія оголосила, що система ШІ буде аналізувати не тільки коментарі, але і самі пости.

Коли інженери хочуть навчити машину виконувати ту чи іншу задачу, вони починають зі створення навчального набору – набору простих термінів, набору матеріалу, який допоможе машині зрозуміти правила її нової роботи. У цьому випадку пошук починається з того, що модератори сортують сотні тисяч фрагментів контенту і вирішують, чи містять вони знущання чи ні. Вони позначають їх і вводять приклади в так званий класифікатор. Звичайно, ці початкові приклади не можуть охопити все, з чим зіткнеться класифікатор в реальному житті. Але він позначає контент і як люди-модератори теж вчиться на додаткових прикладах. В ідеалі, за допомогою інженерів, налаштовуючи свої звички вивчення, він стає все краще і краще з плином часу.

Сьогодні Instagram використовує для сканування контенту три окремих класифікатора буллінгу. Один навчений на розпізнавання образливого тексту, другий – фотографій, третій – відео. Класифікатори вже живуть в нормальному режимі: працюють, шукають і позначають контент. Проте, вони поки знаходяться «на досить ранній стадії розробки», говорить провідний інженер Йоав Шапіра. Іншими словами, вони пропускають багато знущань, і не обов’язково знаходять образи. Тобто допускають багато хибнопозитивних і помилково негативних спрацьовувань.

Розпізнати грубості складніше, ніж навчити нейромережі, наприклад, знаходити наготу, оскільки набагато легше розпізнати, коли хтось на фотографії не носить штани, ніж розпізнати широкий спектр поведінки, яке може вважатися знущанням. Дослідження кіберзалякування сильно відрізняються в своїх висновках про те, скільки людей зазнали його – від 5% до 72%, частково через те, що ніхто однозначно не згоден з тим, що це таке. «Те, що робить знущання настільки важким для розрізнення, полягає в тому, що визначення настільки відрізняється у різних людей», – каже Карина Ньютон, глава по публічній політиці Instagram.

Іншими словами, якесь зауваження може глибоко образити одну людину, а інша сприйме його абсолютно нейтрально і спокійно, тобто взагалі не прийме за образу. А інженерам потрібно дати чіткі інструкції, що саме кваліфікується як буллінг, а що ні, щоб побудувати надійний набір даних для навчання.

Форми знущань в Instagram з часом змінилися, пише Time. Є багато того, що можна назвати «старомодними знущаннями»: це найпоширеніші коментарі, образи і погрози, згідно власним дослідженням Instagram. Деякі з них легко виявити. Текстовий класифікатор, наприклад, добре навчений шукати пропозиції типу «Ти потворна дупа, с ** а з зубами» (you ugly ass gapped tooth ass bitch) або «Твоя дочка потвора» (Your daughter is a slag). Але сленг змінюється з часом і в різних культурах, особливо в молодіжній. А для виявлення агресивної поведінки потрібно осмислення повних пропозицій, а не тільки декількох слів. Є різниця між «Я прийду пізніше» і «Я прийду пізніше, що б ти не говорив».

Користувачі Instagram також стають жертвами агресивної поведінки, яке виходить за рамки слів. На сайті є так звані «сторінки ненависті», анонімні облікові записи, присвячені висміювання людей. Хлопець може поставити тег своєї колишньої дівчини на повідомленнях, де він з іншими дівчатами. Або дівчина може помітити купу друзів в повідомленні і демонстративно виключити когось. Інші можуть зробити скріншот чиєїсь фотографії, змінити її або просто знущатися над нею в груповому чаті. Є повторюється контент як образу – наприклад, розміщення одного і того ж смайлика на кожній фотографії, яку публікує людина, що імітує переслідування. Багато підлітків знаходять незручні фотографії або відео зі своєю участю, розміщені без їх згоди, або виявляються предметом голосування HotOrNot (приблизно таку голосовалку під назвою Facemash створив Марк Цукерберг, будучи студентом Гарварда, на веб-сайті, який пізніше був перейменований в Facebook).

В рамках своїх зусиль з розробки ефективного штучного інтелекту Instagram зараз проводить опитування тисяч користувачів в надії краще зрозуміти всі форми, які можуть приймати знущання, в очах аудиторії. Відповіді також допоможуть Instagram оцінити поширеність знущань на платформі. Ці дані вперше будуть оприлюднені в цьому році.

Зараз для навчання класифікатора команда Шапіри розбила буллінг на сім підкатегорій:

- образи,

- присоромлення,

- погрози,

- атаки на особистість,

- неповага,

- небажані контакти,

- зради.

Грандіозний план полягає у створенні штучного інтелекту, який навчений розуміти кожну концепцію.

Оскільки знущання можуть бути прив’язані до внутрішнього контексту і тому, наскільки добре двоє людей знають один одного, інженери Instagram також досліджують способи аналізу активності і історію користувачів. Наприклад, слово «хо», може бути розцінена як знущання, коли чоловік каже це жінці, але не коли жінка використовує його для привітання одного. Точно так же, якщо хтось колись скаже «приголомшлива картинка», це може бути компліментом. Але якщо вони говорять це на кожній фотографії, яку публікує людина, то це починає виглядати підозріло.

Інженери отримують вигоду від сигналів, які допомагають виявити ці відносини: чи часто два облікові записи ставлять мітки друг у друга? Хто-небудь з них колись в минулому блокував іншого? Чи є ім’я користувача схожим на того, хто був заблокований в минулому? Чи є ознаки скоординованих дій з іншими користувачами?

Коли справа доходить до фотографій і відео, у класифікаторів менше практики і вони менш просунуті. Інженери та модератори поки ідентифікують шаблони, але деякі орієнтири вже з’явилися. Наприклад, екран, розділений на дві половини, часто є ознакою знущань, особливо якщо машина виявляє на одній стороні людину, а на іншій – тварину. Як і фотографія трьох осіб, де обличчя однієї з них замальоване. Команда також вчиться розуміти такі фактори, як постава. Швидше за все, фотографія була зроблена без згоди, якщо вона виглядає як знімок «під спідницею». Якщо одна людина стоїть, а інший знаходиться в позі жертви, це «червоний прапор».

Щотижня дослідники звітують про свої знахідки, і майже щотижня з’являється якась нова форма знущань, яку інженери раніше і не думали шукати, каже Шапіра. Але Facebook і Instagram впевнені, що здатні впоратися з цими проблемами.

Невідомо, скільки з приблизно 1200 співробітників Instagram або приблизно 37 700 Співробітників Facebook працюють над проектом.

Провідний розробник також відмовився повідомити поточний відсоток помилок класифікаторів і обсяг контенту, який вони позначають для модераторів. «У найближчі рік-два буде набагато краще», – тільки сказав Йоав Шапіра.

Також ми розповімо, як саме можна зробити більше 5 екаунтів в Instagram на одному пристрої – для цього вам може знадобитися програма Cloner.

А ще Instagram взялася до тестування нового способу відновлення зламаних облікових записів, для чого вона буде запитувати різну інформацію (таку, як адреса електронної пошти або номер телефону, зазначені при реєстрації). Далі користувач отримає шестизначний код. Новий підхід забезпечить можливість відновлення зламаного облікового запису навіть в тому випадку, якщо зловмисник змінив ім’я користувача і контактну інформацію.