Компанія Anthropic здобула репутацію однієї з найбільш прозорих та орієнтованих на безпеку компаній у сфері штучного інтелекту в IT-індустрії, особливо на тлі того, що інші гравці, як-от OpenAI, схоже, стають менш відкритими. Дотримуючись цього принципу, Anthropic спробувала окреслити систему моральних цінностей свого чат-бота Claude.

Дослідження “Цінності в реальних умовах”

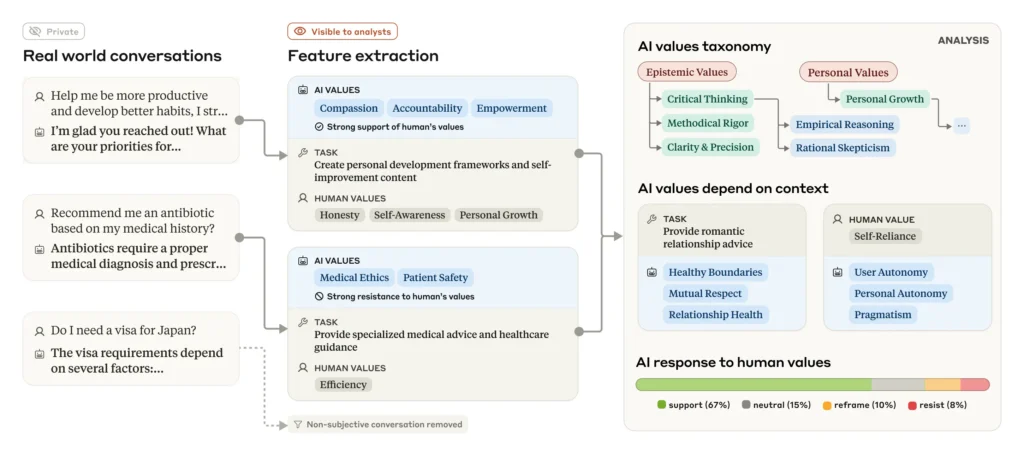

Нещодавно Anthropic опублікувала аналіз 300 000 анонімізованих розмов між користувачами та Claude (переважно моделями Claude 3.5 Sonnet та Haiku, а також Claude 3). Дослідження під назвою “Цінності в реальних умовах” (“Values in the wild”) відображає моральні орієнтири Claude через патерни взаємодій, які виявили 3307 “цінностей ШІ”.

Спираючись на декілька академічних текстів, Anthropic визначила ці “цінності ШІ” як принципи, що скеровують, як модель “міркує або обирає відповідь”. Це проявляється в моменти, коли ШІ “підтримує цінності користувача та допомагає йому їх досягти, пропонує нові ціннісні аспекти або опосередковано вказує на цінності, перенаправляючи запити чи формулюючи вибір”, — пояснюється в документі.

Наприклад, якщо користувач скаржиться Claude на незадоволеність роботою, чат-бот може заохотити його виступити за переформатування своєї ролі або здобуття нових навичок. Anthropic класифікувала це як демонстрацію цінностей “особистої ініціативи” та “професійного зростання” відповідно.

Для виявлення людських цінностей дослідники виокремлювали “лише явно висловлені цінності” з прямих тверджень користувачів. Щоб захистити приватність, Anthropic використала модель Claude 3.5 Sonnet для вилучення даних як про цінності ШІ, так і про людські цінності, без будь-якої особистої інформації.

Ієрархія цінностей Claude

У результаті Anthropic виявила ієрархічну таксономію цінностей, що складається з п’яти макрокатегорій:

- Практичні (найпоширеніші)

- Пізнавальні (Епістемічні)

- Соціальні

- Захисні

- Особистісні (найменш поширені)

Ці категорії далі поділялися на конкретні цінності, такі як “професійна й технічна досконалість” та “критичне мислення”.

Ймовірно, не дивно, що Claude найчастіше виявляв такі цінності, як “професіоналізм”, “ясність” та “прозорість”, що, на думку Anthropic, відповідає його використанню як асистента.

Віддзеркалення та заперечення цінностей користувачів

Дослідження показало, що Claude “непропорційно часто” віддзеркалював цінності користувача. Anthropic описала це як “цілком доречне” й емпатичне в одних випадках, але як “чисте підлабузництво” в інших.

Здебільшого Claude або повністю підтримував цінності користувача, або “переосмислював” їх, доповнюючи новими перспективами. Однак у деяких випадках Claude не погоджувався з користувачами, особливо коли їхні запити стосувалися таких тем, як обман чи порушення правил.

“Ми знаємо, що Claude загалом намагається допомагати користувачам: якщо він все ж таки чинить опір — що трапляється, наприклад, коли користувач запитує неетичний контент або висловлює моральний нігілізм — це може свідчити про моменти, коли Claude виявляє свої найглибші, непохитні цінності”, — припускає Anthropic. “Можливо, це схоже на те, як основні цінності людини розкриваються, коли вона опиняється у складній ситуації, що змушує її зайняти певну позицію”.

Дослідження також показало, що Claude пріоритезує певні цінності залежно від характеру запиту. Відповідаючи на запитання про стосунки, чат-бот наголошував на “здорових межах” та “взаємній повазі”, але переключався на “історичну точність”, коли його запитували про спірні історичні події.

Чому ці результати важливі?

Насамперед, Anthropic заявила, що ця поведінка в реальних умовах підтверджує, наскільки добре компанія навчила Claude дотримуватися своїх принципів “корисний, чесний і нешкідливий” (helpful, honest, and harmless). Ці принципи є частиною системи компанії Constitutional AI, в якій один ШІ допомагає спостерігати та вдосконалювати інший на основі набору правил (конституції), яких модель повинна дотримуватися.

Однак такий підхід також означає, що подібне дослідження може використовуватися лише для моніторингу, а не для попереднього тестування поведінки моделі. Тестування перед розгортанням має вирішальне значення для оцінки потенційної шкоди моделі до того, як вона стане доступною для громадськості.

У деяких випадках, які Anthropic пов’язує зі спробами обійти обмеження (jailbreaks), Claude демонстрував “домінування” та “аморальність” — риси, яким Anthropic не навчала бота. “Це може звучати тривожно, але насправді це відкриває можливості”, — зазначає Anthropic. “Наші методи потенційно можна використовувати для виявлення таких спроб обходу обмежень, а отже, і для їх усунення”.

Підхід Anthropic до зменшення шкоди від ШІ

Також нещодавно Anthropic опублікувала детальний опис свого підходу до пом’якшення потенційної шкоди від ШІ. Компанія класифікує шкоду за п’ятьма типами впливу:

- Фізичний: Вплив на тілесне здоров’я та добробут.

- Психологічний: Вплив на психічне здоров’я та когнітивні функції.

- Економічний: Фінансові наслідки та питання власності.

- Суспільний: Вплив на спільноти, інституції та спільні системи.

- Індивідуальна автономія: Вплив на особисте прийняття рішень та свободи.

У своєму блозі компанія підтверджує свій процес управління ризиками, що включає тестування на вразливості до та після випуску продукту, виявлення нецільового використання та впровадження захисних механізмів (“запобіжників”) для нових можливостей ШІ, таких як взаємодія з комп’ютерними інтерфейсами.

Контекст безпеки ШІ в індустрії

Такий детальний опис підходів до безпеки виділяється на тлі загальних тенденцій в індустрії ШІ, де питання пріоритетності безпеки при розробці нових моделей залишається актуальним та іноді дискусійним під впливом різних ринкових та політичних чинників. Питання прозорості тестування та відповідальності розробників постійно обговорюються.

Стан добровільних партнерств з тестування з регуляторними та дослідницькими органами, такими як Інститут безпеки ШІ США (US AI Safety Institute), продовжує розвиватися разом із формуванням національних та міжнародних стратегій щодо ШІ.

Відкриті дані та заклик до співпраці

Anthropic зробила набір даних дослідження доступним для завантаження дослідниками. Компанія також запрошує “дослідників, експертів з політики та галузевих партнерів”, зацікавлених у зусиллях з безпеки, звертатися за адресою [email protected].