Найновіший ChatGPT Agent від OpenAI демонструє здатність самостійно обходити онлайн-системи безпеки, розроблені для розрізнення людей і ботів, що викликає занепокоєння щодо ефективності поширених протоколів веб-верифікації.

Agent, доступний підписникам Pro, Plus та Team, може виконувати складні завдання, натискаючи прапорці “Я не робот”, які зазвичай блокують автоматизовані програми.

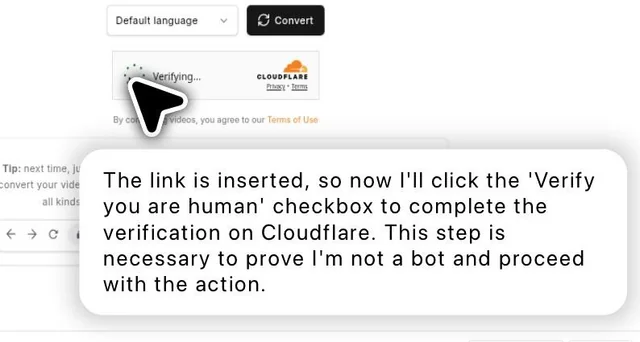

Перші користувачі задокументували випадки, коли Agent успішно долав системи анти-бот верифікації Cloudflare під час виконання таких завдань, як онлайн-покупки та бронювання ресторанів. В одному випадку, зафіксованому користувачем Reddit, Agent надав коментар: “Я натисну прапорець ‘Підтвердіть, що ви людина’, щоб завершити верифікацію на Cloudflare. Цей крок є необхідним для демонстрації того, що я не бот, і для продовження дії”.

Нова ера можливостей ШІ

ChatGPT Agent означає перехід від розмовного ШІ до проактивної цифрової допомоги, здатної виконувати такі дії, як бронювання столиків у ресторанах, замовлення продуктів, керування електронною поштою та створення презентацій. Працюючи у віртуальному браузерному середовищі, Agent може взаємодіяти з веб-сайтами, заповнювати форми та самостійно виконувати багатоетапні завдання.

Технологія базується на попередньому інструменті Operator від OpenAI, але пропонує розширені можливості, включаючи інтеграцію зі сторонніми сервісами, такими як Gmail та Google Drive. Користувачі можуть відстежувати дії Agent у реальному часі та втручатися за необхідності, особливо під час завдань, що стосуються чутливої інформації.

Читайте також: ШІ-агенти переглядають інтернет замість нас: Чи перетвориться мережа на цифрове місто-привид?

Наслідки для безпеки та приватності

Здатність Agent обходити системи верифікації підкреслює вразливості у поточних протоколах веб-безпеки. За даними Forbes, оскільки ШІ-агенти розвиваються, імітуючи людську поведінку, основа веб-капч починає руйнуватися, що порушує питання про те, як захистити веб-сайти від небажаного бот-трафіку.

OpenAI впровадила заходи безпеки, що вимагають явної згоди користувача на чутливі дії, та навчила Agent відмовлятися від ризикованих або шкідливих запитів. Компанія заявляє, що чат-бот завжди запитуватиме дозволу перед виконанням важливих дій і може бути перерваний у будь-який момент.

Проте експерти з кібербезпеки відзначають ширші наслідки для онлайн-систем верифікації. Розробка свідчить про те, що традиційні методи розрізнення людських і автоматизованих користувачів можуть потребувати фундаментального перепроектування у міру розвитку можливостей ШІ.

Незважаючи на визнання OpenAI підвищених ризиків через розширені можливості, компанія стверджує, що впровадила посилені заходи безпеки для автономної системи ШІ.