Використання ШІ-чатботів стало звичною справою для мільйонів користувачів по всьому світу. ChatGPT, Microsoft Copilot, Claude, Perplexity та Gemini допомагають шукати рецепти, планувати подорожі та отримувати швидкі відповіді на запитання. Попри очевидну корисність, експерти з кібербезпеки попереджають про низку ризиків, яких варто остерігатися при роботі з ШІ-асистентами.

- Нові ризики спілкування з штучним інтелектом

- 1. Ставтеся до ШІ-чатботів як до публічних просторів

- 2. Не діліться надто багато про свій психічний стан

- 3. Не приносьте в чатбот «всього себе»

- 4. Експортуйте свої дані

- 5. Перевіряйте всю інформацію

- 6. Остерігайтеся шахраїв

- 7. Довіряйтеся людям, а не ШІ

- 8. Практикуйте (і захищайте) критичне мислення

- 9. Обмежуйте інтеграції та дозволи

- 10. Навчіться розпізнавати ШІ-генерований контент

Нові ризики спілкування з штучним інтелектом

Спілкування зі штучним інтелектом все ще залишається відносно новим явищем. Хоча звернення до чатботів за ідеями рецептів, плануванням подорожей та швидкими відповідями здебільшого нешкідливе, існує чимало питань безпеки ШІ, про які варто пам’ятати.

Ми часто ділимося дуже особистою інформацією в інтернеті, але ті самі гарантії конфіденційності — які діють у спілкуванні з реальними юристами, терапевтами та лікарями — не поширюються на ШІ-чатботи. Багато користувачів використовують ChatGPT як віртуального лайф-коуча, ділячись особистими та професійними деталями і проблемами через додаток або програму. Існують також когнітивні ризики, пов’язані з використанням великих мовних моделей, адже дедалі більше досліджень вивчають, як залежність від чатботів впливає на утримання пам’яті, креативність та вільність письма.

Нижче — докладний посібник з обережного використання чатботів. Ми пояснимо, чому важливо уникати передачі конфіденційних даних, як реагувати на проблеми з психічним здоров’ям і що можна зробити для запобігання довготривалій когнітивній атрофії через відсутність тренування певних ділянок мозку.

1. Ставтеся до ШІ-чатботів як до публічних просторів

Необхідно пам’ятати, що ШІ-чатботи є «публічним середовищем», а не приватними розмовами, — каже Меттью Стерн, кіберслідчий і генеральний директор CNC Intelligence. «Якщо ми будемо пам’ятати про це, ми з меншою ймовірністю поділимося конфіденційними даними, які можуть стати видимими для інших».

Оскільки історії чатботів стали доступними для пошуку в інтернеті, Стерн радить турбуватися про те, що ваші розмови можуть індексуватися пошуковими системами.

Уникайте передачі будь-якої персональної інформації, як-от повного імені, адреси, фінансових деталей, бізнес-даних та медичних результатів. Чим більше ви ділитеся, тим персоналізованішими будуть ваші результати. Звісно, на перший погляд це може здатися позитивним.

Але передача конфіденційних даних технологічній компанії має насторожувати. Навіть якщо ці деталі не стануть публічно доступними для пошуку, ви ніколи не знаєте, яку інформацію про вас купуватимуть і продаватимуть брокери даних.

2. Не діліться надто багато про свій психічний стан

Чатботи можуть бути корисними асистентами, але вони не ваші друзі, — каже Елі Берребі, керівник напрямку SEO та AI Search в Adorama. Він радить «зберігати свої секрети» і ніколи не обговорювати психічний стан, страхи чи проблеми зі здоров’ям. Такі дані можна використовувати для виявлення прихованих патернів та підсвідомих намірів, створюючи профіль вразливості.

«Не діліться надмірно. Вони вже знають про вас більше, ніж ви могли б уявити», — каже Берребі.

Крім того, пам’ятайте, що основна мета ШІ-чатботів — монетизація, тобто генерування доходу. «Незабаром цю персоналізацію використовуватимуть для показу вам ультрацільової реклами, — каже він. — Ці дані безцінні для рекламодавців, але вони створюють профіль спостереження глибший за все, що ми бачили дотепер».

3. Не приносьте в чатбот «всього себе»

ШІ-чатботи існують в економіці уваги, де вашa залученість є продуктом, — каже міжкультурна стратегиня Анналіса Неш Фернандес. «Якщо чатботи зрештою монетизуються через збір даних та утримання користувачів, функції пам’яті стають інструментами залучення, замаскованими під персоналізацію, адже увага передує всьому, включно з вашою приватністю».

Вимкніть функції пам’яті, щоб зменшити те, що системи зберігають про вас. Для ChatGPT: перейдіть до Налаштування > Персоналізація > вимкніть Пам’ять та Режим запису.

Використовуйте додаткові електронні адреси, щоб чатботи не мали цього типу ідентифікатора для вас — електронна пошта є «сполучною тканиною, що пов’язує розрізнені точки даних», каже Фернандес.

Відмовтеся від тренування, щоб чатбот не тренувався на ваших введеннях. У ChatGPT: клацніть на свій профіль/ім’я, виберіть Налаштування > Керування даними > Поліпшити модель для всіх і вимкніть це.

Берребі також радить «фрагментувати свої дані», перемикаючись між різними ШІ-чатботами, щоб уникнути надання одній організації повної картини вашого життя.

4. Експортуйте свої дані

Незалежно від того, який ШІ-чатбот ви використовуєте, регулярно експортуйте свої дані, щоб побачити, яку інформацію він зберігає про вас.

У ChatGPT: перейдіть до Налаштування > Керування даними > Експортувати дані. Вам надішлють посилання з ZIP-файлом текстів та фотографій.

5. Перевіряйте всю інформацію

Завжди дотримуйтеся обережності щодо контенту, створеного ШІ. Очікуйте помилок та ставтеся до інформації зі скептицизмом. ШІ-чатботи створені бути корисними — вони є втіленням бажання догодити. Це не означає, що інформація правдива чи точна.

Когнітивні упередження також є проблемою з чатботами. Якщо ви використовуєте їх як інтелектуального партнера, вони віддзеркалюватимуть те, що ви вводите, по суті стаючи абсолютною ехо-камерою.

Завжди перевіряйте джерела та запитуйте, звідки отримано інформацію. Також трапляються «галюцинації ШІ», коли чатботи фальсифікують інформацію на основі ненадійних онлайн-джерел або через неправильні висновки.

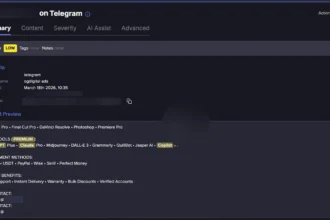

6. Остерігайтеся шахраїв

ШІ-чатботи здатні підтримувати багатоходові розмови, — каже Рон Кербс, генеральний директор Kidas, компанії, що захищає від шахрайства та онлайн-загроз. Ці діалоги типу «питання-відповідь» можуть імітувати зловмисники на підозрілих вебсайтах, видаючи себе за корисні чатботи служби підтримки.

«Хоча великі платформи як ChatGPT загалом безпечні, ризик полягає в тому, що користувачі ненавмисно діляться обліковими даними через фішингові посилання або підроблені сторінки входу, які часто поширюються електронною поштою, SMS або клонованими вебсайтами, — каже Кербс. — Коли облікові дані скомпрометовані, шахрай може зловживати обліковим записом, особливо якщо він пов’язаний із збереженими методами оплати».

Кербс наголошує на необхідності вмикати двофакторну автентифікацію, контролювати доступ до облікового запису та уникати входу через сторонні посилання. Це може бути менш зручно, але це невелика ціна.

Хоча поки що немає антивірусного еквівалента для ШІ-чатботів, деякі інструменти пропонують виявлення шахрайства як рівень щоденного захисту, особливо коли вбудовані в платформи обміну повідомленнями та постачальників послуг.

Кербс каже, що важливо не лише сканувати жорсткий диск на віруси, а й відстежувати свою взаємодію через SMS, електронну пошту та голосові виклики на предмет потенційного шахрайства. Захист від дипфейків також може аналізувати аудіо та відео, щоб виявити, чи є особа, з якою ви розмовляєте, ШІ-клоном.

7. Довіряйтеся людям, а не ШІ

Ця порада не тактична, але важлива: хоча ви можете не бачити шкоди в тому, щоб говорити з ChatGPT, Claude чи Gemini про проблему, це слизький шлях до використання чатбота як щоденника.

Натомість зателефонуйте доброму другові або заплануйте зустріч, щоб поділитися тим, через що ви проходите, з кимось, хто дбає про вас — а не з прогнозованою ШІ-моделлю, натренованою незнайомцями.

8. Практикуйте (і захищайте) критичне мислення

Не передавайте своє мислення ШІ на аутсорсинг. Поточне дослідження MIT (яке ще не пройшло експертну оцінку) провело попереднє вивчення потенційної шкідливості великих мовних моделей для нашого психічного стану, показавши «слабший нейронний зв’язок» у мозку учасників, які використовували ChatGPT.

Використовуйте ШІ для завдань низького рівня, але тримайте створення, мислення та стратегування поза алгоритмами.

9. Обмежуйте інтеграції та дозволи

Багато ШІ-чатботів пропонують інтеграцію з іншими сервісами — електронною поштою, календарями, хмарними сховищами. Перед тим як надавати такі дозволи, критично оцініть, чи дійсно вам потрібна ця функціональність.

Кожна додаткова інтеграція — це потенційна точка вразливості. Якщо обліковий запис ШІ-сервісу буде скомпрометовано, зловмисники отримають доступ і до підключених сервісів. Регулярно переглядайте список наданих дозволів та відкликайте ті, які більше не використовуєте.

10. Навчіться розпізнавати ШІ-генерований контент

Останній, але не менш важливий аспект — розуміння того, коли ви спілкуєтеся з ШІ. Зловмисники можуть використовувати чатботи для маніпуляцій, поширення дезінформації або соціальної інженерії. Розвивайте критичне мислення та скептично ставтеся до інформації, особливо якщо вона викликає сильні емоції або вимагає термінових дій.

Пам’ятайте, що навіть найпросунутіші ШІ-асистенти — це інструменти, які потребують відповідального використання. Дотримання цих простих правил допоможе вам користуватися перевагами штучного інтелекту без ризику для вашої безпеки та конфіденційності.