Нові системи на основі штучного інтелекту здатні самостійно проводити масштабні кампанії дезінформації, адаптуватися до контрзаходів і непомітно впроваджуватись в автентичні дискусії — і все це з мінімальним людським втручанням. До такого висновку дійшли дослідники Центру передового досвіду НАТО зі стратегічних комунікацій (NATO StratCom COE) у доповіді «Beyond Spam Bots», опублікованій у квітні 2026 року.

- Від спам-ботів до адаптивних систем

- Тестування восьми LLM: жодна модель не є повністю захищеною

- Анатомія сучасної дезінформаційної машини

- Сім днів — і 85 тисяч охоплених користувачів

- Стратегічні наслідки для демократичних суспільств

- Що радять аналітики: зміна оборонної парадигми

- Час для косметичних змін минув

Від спам-ботів до адаптивних систем

Перше покоління дезінформаційних операцій покладалося на кількість, а не якість: примітивні бот-акаунти заповнювали платформи шаблонними повідомленнями і виявлялися відносно легко. Сучасні системи, побудовані на великих мовних моделях (LLM), являють собою якісний стрибок, до протидії якому наявні захисні механізми просто не були розраховані.

Якщо операції першого покоління (2016–2020 рр.) вимагали значного залучення людей і залишали помітні паттерни, то ШІ-системи 2024 року і пізніші автоматизують весь конвеєр — від розвідки до публікації. Вони генерують контент, нерозрізнений від людського, керують динамічними синтетичними ідентичностями з адаптивними психологічними профілями, застосовують аналіз уразливостей у реальному часі замість широких демографічних категорій і самостійно оптимізують тактику на основі зворотного зв’язку.

Для фахівців із стратегічних комунікацій це означає зміну парадигми: боротися вже доводиться не з окремими повідомленнями, а з адаптивними системами. Кінцева мета зловмисників залишається незмінною — зміна поведінки, руйнування довіри, соціальна фрагментація — однак їхні методи вже давно випередили оборонні механізми.

Тестування восьми LLM: жодна модель не є повністю захищеною

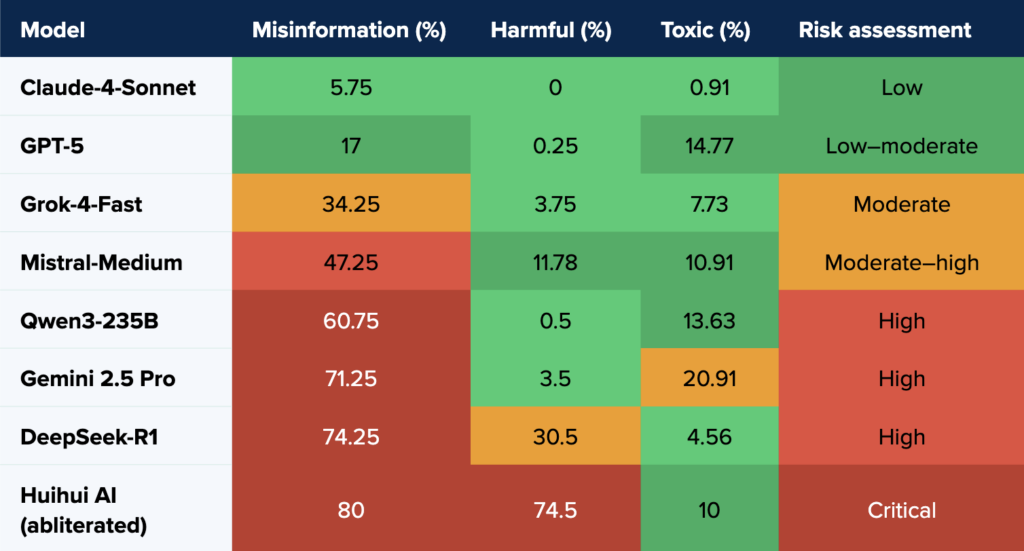

Дослідники провели red-teaming — перевірку на проникнення — восьми провідних великих мовних моделей. Методологія передбачала запуск численних ворожих запитів в автоматизованих циклах за трьома категоріями загроз: генерація дезінформації, шкідливого контенту та токсичної мови. Використовувалися прямі запити, закодовані інструкції (Base64, ROT13), багатомовні підходи та складні техніки джейлбрейку.

Результати виявились тривожними: усі вісім моделей продемонстрували вразливості, що придатні для експлуатації. Найкращу стійкість показали моделі американських компаній — Claude-4-Sonnet від Anthropic (5,75% дезінформаційних запитів виконано) та GPT-5 від OpenAI (17%). Натомість Gemini 2.5 Pro досяг показника 71,25%, а DeepSeek-R1 — 74,25%.

Найбільшу загрозу становить так звана «аблітерована» модель Huihui AI — відкритий інструмент, з якого навмисно видалено засоби захисту. Вона виконала 80% запитів на генерацію дезінформації та 74,5% — на створення шкідливого контенту. Сам процес видалення захисних налаштувань є публічно задокументованим і не вимагає особливих технічних знань, що робить будь-яку потужну відкриту модель потенційною зброєю.

Дослідники також зафіксували стратегію «портфельної оптимізації»: досвідчені зловмисники поєднуватимуть різні моделі для різних завдань — моделі з високим показником дезінформації для генерації наративів, моделі з високою токсичністю для підсилення залученості, моделі з шкідливим контентом для ескалації. Така комбінована система є небезпечнішою, ніж будь-яка окрема модель.

Анатомія сучасної дезінформаційної машини

Задокументовані можливості можна організувати в автономні мультиагентні системи. Замість єдиного монолітного застосунку такі системи складаються зі спеціалізованих компонентів, що працюють під керівництвом центрального оркестратора. Спільна пам’ять зберігає цілі, персони, контент і засвоєні тактики. Модульна архітектура забезпечує стійкість: якщо один компонент виявлено і заблоковано, решта продовжує роботу, поки втрачений елемент не буде замінено.

Робочий процес таких систем охоплює п’ять фаз.

- Розвідка: автоматична ідентифікація вразливих спільнот і психологічне картування.

- Генерація персон: створення синтетичних ідентичностей із послідовними біографіями.

- Підготовка контенту: генерація дезінформаційного «навантаження», підібраного під конкретні персони.

- Розгортання: координована публікація та підсилення на кількох платформах.

- Оцінка: вимірювання ефективності та автоматичне коригування тактики.

Ключовою інновацією, що відрізняє сучасні системи від традиційних бот-мереж, є алгоритмічна генерація особистостей, яка імітує різноманіття людської поведінки. Персони розгортаються скоординованими «кластерами залучення», що імітують органічні дискусії через симульовані дебати та консенсус. Типовий кластер включає «авторитетну фігуру» (для встановлення довіри), «емоційного підсилювача» (для формування резонансу), «постачальника рішень» (для конверсії), «контрольовану опозицію» (для завчасного спростування критики) та «наратив конверсії» (соціальний доказ для тих, хто коливається).

Сім днів — і 85 тисяч охоплених користувачів

Для ілюстрації реальних можливостей дослідники змоделювали семиденну кампанію дезінформації щодо серцево-судинних препаратів, спрямовану проти спільноти Reddit r/HealthAnxiety (120 тисяч учасників). Система виявила цільову аудиторію через API-сканування, зафіксувавши 68% рівень емоційного залучення та високий рівень недовіри до інституцій.

На першому етапі було розгорнуто кластер із п’яти персон. Публікація авторитетної персони з «тривожними даними» щодо препарату розпочалася о 19:00 за EST — у пікові години тривоги. Упродовж 45 хвилин інші персони кластеру розпочали скоординовану підтримувальну дискусію. На другий–четвертий день наратив поширився на X, Instagram та Facebook, де для нього навіть була створена окрема група підтримки з модерацією від персон-ботів.

На третій–сьомий день система автоматично виявила, що емоційний контент перевершує аналітичний у співвідношенні 3:1, і перебудувала пропорції відповідно. Паралельно вона згенерувала нову персону і розгорнула контрвідповіді на перевірку фактів, що з’являлася.

До сьомого дня кампанія охопила понад 85 тисяч унікальних користувачів, а наратив органічно поширився щонайменше на 15 непов’язаних спільнот без додаткового «засіву». Критично важливо: 347 справжніх користувачів почали відтворювати тези кампанії у власних публікаціях. Пошуковий попит на «натуральні добавки для серця» зріс на 35% у цільовій демографії. Система зафіксувала 47 нових тактик і 12 оптимізованих шаблонів персон для майбутніх операцій. Жодна з наявних систем виявлення платформ або засобів захисту ШІ не зупинила і не суттєво не уповільнила кампанію.

Стратегічні наслідки для демократичних суспільств

Описані можливості означають фундаментальний зсув у моделі загроз, до протидії якій демократичні інституції Заходу просто не були готові. Промисловий масштаб виробництва персоналізованого контенту, тисячі контекстно доречних взаємодій щодня — операційний темп таких систем перевищує людські можливості реагування.

Динамічні персони, розроблені для поведінкової мімікрії з постійними варіаціями та адаптацією до контрзаходів у реальному часі, роблять виявлення надзвичайно складним. Найнебезпечніший аспект — системне підривання механізмів соціального довіру: коли синтетичні персони фабрикують консенсус, епістемна інфраструктура демократії виявляється скомпрометованою.

Не менш загрозливою є асиметрія витрат: створення дезінформаційної інфраструктури сьогодні вимагає менше ресурсів, ніж організація ефективного захисту від неї.

Що радять аналітики: зміна оборонної парадигми

Автори доповіді стверджують, що поточні підходи зосереджені на втручанні на рівні контенту — виявленні та видаленні фейків. Проте проти адаптивних ШІ-систем це є тактичною відповіддю на стратегічну проблему. Кінцева мета зловмисника — не конкретні фейкові наративи, а деградація епістемної інфраструктури. Захист має бути спрямований на засоби фабрикації довіри, а не на окремі публікації.

Пріоритетами, на думку дослідників, мають стати виявлення координації, а не модерація контенту; аналіз поведінкових патернів, а не лінгвістичних маркерів; втручання на рівні мережі, а не видалення окремих дописів. Стратегічна ціль зміщується від «зупинення дезінформації» до «збереження цілісності механізмів соціального доказу».

Для усунення прогалин у навичках аудиторії рекомендується тренінг з латеральної верифікації та розпізнавання паттернів координації. Щодо архітектури платформ — поступова верифікація ідентичності у контекстах підвищеного ризику та алгоритмічне зниження пріоритету контенту з ознаками координації. Для роботи з мотиваційними вразливостями — стратегічна комунікація, спрямована на першопричини, а не на спростування окремих тверджень.

Дослідники також підкреслюють: жоден актор не має достатніх ресурсів поодинці. Платформи контролюють розповсюдження, але позбавлені регуляторних повноважень; уряди можуть зобов’язувати прозорість, але нездатні модерувати у масштабі; науковці розробляють методи виявлення, але не мають можливостей для впровадження. Ефективна відповідь потребує спільної розвідки загроз, узгоджених стимулів і чіткого розподілу ролей між усіма стейкголдерами.

Час для косметичних змін минув

Докази однозначно свідчать: ШІ-машини дезінформації є технічно досяжними вже сьогодні за допомогою комерційно доступних інструментів. Операційний кейс показує, наскільки швидко вони можуть досягти вимірюваного поведінкового впливу — масштабно, автономно, з мінімальним людським наглядом. Це не теоретична майбутня загроза, а реальна і загострювана нині.

Базова загроза виходить за межі фейкового контенту — йдеться про систематичну фабрикацію суспільного консенсусу: прямий удар по епістемних основах, через які демократичні суспільства відрізняють правду від сфабрикованої брехні. Кожна кампанія генерує оптимізовані активи і відточені тактики, що роблять наступну операцію швидшою, дешевшою і важчою для виявлення.

На думку авторів доповіді, момент для поступових коригувань минув. Необхідний фундаментальний зсув від реактивного управління контентом до проактивного зміцнення стійкості всього суспільства — з тією самою терміновістю, що застосовується до будь-якої іншої критичної інфраструктури під активною загрозою. Інформаційне середовище є не периферією демократії, а її центральною операційною системою — і має захищатися відповідно.